Einleitung #

Das Problem #

Ich nutze täglich mehrere KI-Modelle: ChatGPT für alltägliche Fragen und Recherchen, Claude um Code besser zu verstehen. Aber ich wollte auch Gemini und DeepSeek ausprobieren (nicht nur im kostenlosen Plan). Ein Premium-Abonnement für jedes einzelne davon wäre teuer – Beispielsweise die monatlichen Kosten (Stand Dezember 2025):

- Claude Pro: 21,42 €

- ChatGPT Plus: 23 €

- Google AI Plus: 7,99 €

Zusammenfassend müsste ich mindestens etwa 52 € pro Monat bezahlen – natürlich könnte ich mich auch an die kostenlosen Pläne halten, aber ich stoße dabei ziemlich schnell an die Grenzen.

Meine Lösung #

Dann hörte ich von OpenRouter (großer Dank an meinen Teamleiter, der mich darauf aufmerksam gemacht hat). OpenRouter gibt mir die Möglichkeit, auf Hunderte von Modellen gleichzeitig zuzugreifen, indem ich nur das bezahle, was ich tatsächlich nutze.

Die Bezahlung basiert auf der Nutzung von Tokens (Erklärung hier), was (für mich) jeden Monat deutlich günstiger ist (etwa 10 € bis 20 €). Und wenn ich Monate habe, in denen ich die KI kaum nutze, muss ich nichts bezahlen. OpenRouter in Kombination mit OpenWebUI ist klasse - folge dieser Anleitung, wenn du es selbst einrichten möchtest.

Bonus: Schutz personenbezogener Daten #

Wenn bei der Verwendung von KI in OpenWebUI personenbezogene Daten geschützt werden soll, habe ich eine Anleitung zu „Pasteguard“ verfasst – ein Tool, das genau das tut:

Die Konfiguration für OpenRouter ist am Ende der Anleitung zu finden.

Voraussetzungen #

- Account bei OpenRouter

- Server zum Hosten von OpenWebUI

- Docker auf dem Server installiert

Es ist 100 % möglich, OpenRouter ohne OpenWebUI zu verwenden, aber ich bevorzuge es.

Einrichtung #

OpenRouter #

- Erstelle einen Account bei OpenRouter und melde dich an.

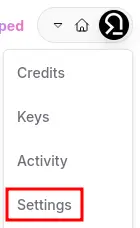

- Greife auf deine Kontoeinstellungen zu:

-

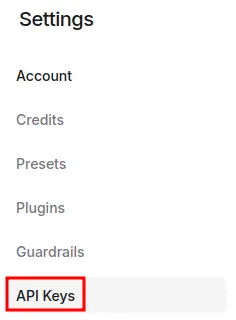

- Öffne den Abschnitt “API Keys”:

-

- Erstelle einen neuen API-Schlüssel (passe die Einstellungen an deine Bedürfnisse an) und speichere ihn!

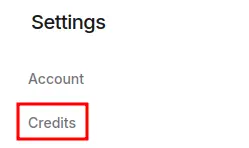

- Wechsle nun zu “Credits”:

-

- Kaufe einige Credits. Du kannst niedrig anfangen, zum Beispiel mit 5 € – mehr als genug zum Testen. Haftungsausschluss: OpenRouter erhebt eine Gebühr für die Nutzung ihrer Dienste – 5,5 % des Betrags der Credits, die du kaufst.

OpenWeb UI #

- Greife auf deinen Server zu und installiere Docker, falls du es noch nicht installiert hast. Es gibt viele Anleitungen online für jeden OS-Typ, daher werde ich es hier nicht erklären.

- Erstelle eine neue “docker-compose.yml” und füge den Docker Compose von OpenWebUI ein. Beispiel docker-compose.yml (aus den offiziellen Docs):

-

services:

openwebui:

image: ghcr.io/open-webui/open-webui:main

ports:

- “3000:8080”

volumes:

- open-webui:/app/backend/data

volumes:

open-webui:

```

4. Starte den Dienst mit docker compose up -d.

5. Nach der Installation besuche http://localhost:3000, um Open WebUI auf dem Server zu erreichen. Wenn du von einem Client darauf zugreifen möchtest, gib die IP-Adresse des Servers und den Port 3000 ein, zum Beispiel: http://192.168.178.13:3000.

6. Erstelle einen Account und melde dich an.

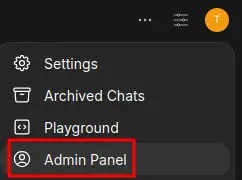

7. Gehe zum Admin-Panel:

8.

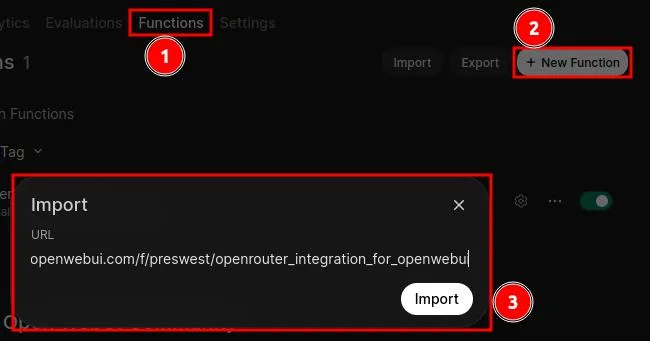

https://openwebui.com/f/preswest/openrouter_integration_for_openwebui und importiere ihn:

Gut zu wissen #

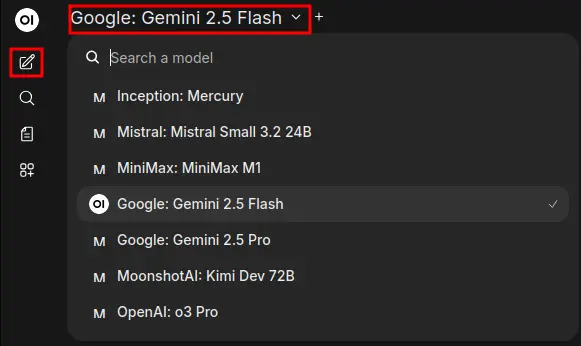

Du kannst deine Token-Nutzung in OpenRouter sehen, um ein Gefühl dafür zu bekommen, wie viel deine Anfragen kosten. Wenn du Token sparen möchtest, gib einen System-Prompt ein, der der KI sagt, kurz und prägnant zu antworten und keine Emojis oder Klischees zu verwenden. Wir brauchen die KI nicht, um Token dafür auszugeben, mir mit 10 verschiedenen Emojis zu sagen, dass meine Frage großartig ist. Ich bin kein “Prompt-Profi”, versuche, deinen eigenen System-Prompt nach deinen Wünschen zu erstellen. Du kannst ihn in den Chateinstellungen von OpenWeb UI eingeben:

Stelle deine Fragen außerdem kurz und präzise, wenn du noch weniger Tokens verwenden möchtest. Du musst dich nicht mit “Danke” bedanken, was ebenfalls Tokens verbrauchen würde – dieser Artikel der New York Times hilft zu verstehen, warum: Saying ‘Thank You’ to ChatGPT Is Costly.